DeepSeek R1とは?

DeepSeek R1は、中国のAIスタートアップDeepSeek社が開発したオープンソースの推論特化型大規模言語モデルです。2025年1月にリリースされ、OpenAIのo1に匹敵する推論性能をオープンソースで実現したことで大きな注目を集めました。

最大の特徴は「完全無料でローカル実行できる」という点です。クラウドAPI経由で利用する場合もトークン単価が非常に安いですが、Ollamaなどのツールを使えば自分のPC上で動かすことができ、月額料金もAPI料金も一切かかりません。データが外部サーバーに送信されないため、機密情報を含む業務でも安心して使えます。

フリーランスや個人事業主にとって「毎月のAIツール費用を抑えたい」「クライアント情報をクラウドに送りたくない」というニーズは切実です。DeepSeek R1のローカル実行は、この2つの課題を同時に解決する選択肢として注目されています。

DeepSeek R1の主な機能

推論特化(Chain of Thought)

DeepSeek R1の中核機能は「推論特化」です。プロンプトを受け取ると、内部で段階的な思考プロセス(Chain of Thought)を実行し、複雑な問題を論理的に解いていきます。

数学的な証明・プログラミングのアルゴリズム設計・論理パズル・戦略的な意思決定など、単純な知識検索では解けないタスクで高い性能を発揮します。推論の過程が「

複数サイズのモデル展開

DeepSeek R1にはフルサイズの671Bパラメータモデルに加え、ローカル実行向けに蒸留(Distill)された軽量モデルが複数用意されています。

| モデル | パラメータ数 | 必要VRAM | 用途 |

|---|---|---|---|

| DeepSeek-R1(フル) | 671B(MoE) | 300GB以上 | サーバー向け |

| DeepSeek-R1-Distill-Qwen-32B | 32B | 20GB | 高性能GPU向け |

| DeepSeek-R1-Distill-Qwen-14B | 14B | 10GB | ミドルクラスGPU |

| DeepSeek-R1-Distill-Qwen-7B | 7B | 6GB | 一般的なGPU |

| DeepSeek-R1-Distill-Qwen-1.5B | 1.5B | 2GB | CPU実行可能 |

フリーランスが個人PCで実行する場合は、7Bまたは14Bモデルが現実的な選択肢です。1.5Bモデルは軽量ですが推論品質が落ちるため、簡単なタスク専用と考えてください。

オープンソース(MITライセンス)

DeepSeek R1はMITライセンスで公開されており、商用利用を含めて自由に使えます。蒸留モデルの一部はApache 2.0ライセンスですが、いずれも商用利用に制限はありません。

自社サービスへの組み込み・クライアント向けシステムへの導入・カスタマイズしたモデルの再配布も可能で、フリーランスエンジニアがクライアント案件に活用する際にもライセンス上の問題がありません。

ローカル実行に必要なスペック

DeepSeek R1をローカルで動かすために必要なPCスペックを、モデルサイズ別に整理します。

7Bモデル(推奨:最もバランスが良い)

- GPU: NVIDIA RTX 3060以上(VRAM 6GB以上)

- RAM: 16GB以上

- ストレージ: 10GB以上の空き

- OS: Windows / macOS / Linux

GPUがなくてもCPUだけで動作しますが、応答速度が大幅に遅くなります(10倍以上)。Apple Silicon Mac(M1以降)であればGPU統合メモリを活用でき、専用GPUがなくても快適に動作します。

14Bモデル(品質重視)

- GPU: NVIDIA RTX 4070以上(VRAM 12GB以上)

- RAM: 32GB以上

- ストレージ: 15GB以上の空き

推論品質は7Bより明確に高いですが、必要スペックも上がります。M2 Pro / M3 Pro以上のMacであれば快適に動作します。

1.5Bモデル(軽量・お試し)

- GPU: 不要(CPUで動作)

- RAM: 8GB以上

- ストレージ: 3GB以上の空き

スペックの低いPCでも動作しますが、推論品質はChatGPTの無料版にも及びません。「ローカルLLMの動作確認」や「簡単な質問応答」程度の用途向けです。

ローカル実行の手順(Ollama編)

DeepSeek R1をローカルで動かす最も簡単な方法はOllamaを使うことです。コマンド2つで完了します。

Step 1: Ollamaのインストール

Ollama公式サイト(ollama.com)にアクセスし、自分のOSに合ったインストーラーをダウンロードします。

Macの場合はHomebrew経由でもインストールできます。ターミナルで以下を実行してください。

“` brew install ollama “`

Windowsの場合は公式サイトからインストーラー(.exe)をダウンロードして実行します。Linuxの場合は以下のコマンドです。

“` curl -fsSL https://ollama.com/install.sh | sh “`

Step 2: DeepSeek R1モデルのダウンロードと実行

インストール完了後、ターミナル(コマンドプロンプト)で以下を実行するだけです。

“` ollama run deepseek-r1:7b “`

初回はモデルのダウンロード(約4.7GB)が行われます。ダウンロード完了後、すぐにチャットが始まります。プロンプトを入力すれば日本語で回答が返ってきます。

14Bモデルを使いたい場合は以下のように指定します。

“` ollama run deepseek-r1:14b “`

1.5Bモデル(軽量版)は以下の通りです。

“` ollama run deepseek-r1:1.5b “`

Step 3: Web UI(オプション)

コマンドラインが苦手な場合は、Open WebUIを導入するとブラウザ上でChatGPTのような画面で使えます。

“` docker run -d -p 3000:8080 –add-host=host.docker.internal:host-gateway ghcr.io/open-webui/open-webui:main “`

ブラウザで http://localhost:3000 にアクセスすればチャットUIが表示されます。Dockerが必要ですが、一度セットアップすれば使い勝手はChatGPTとほぼ同じです。

料金

DeepSeek R1のローカル実行は完全無料です。

| 項目 | 料金 |

|---|---|

| モデルダウンロード | 無料 |

| ローカル実行 | 無料 |

| 商用利用 | 無料 |

| Ollama | 無料(オープンソース) |

| Open WebUI | 無料(オープンソース) |

電気代とPC購入費用以外のコストは一切かかりません。月額$20のChatGPT PlusやClaude Proと比較すると、年間で約3万円以上のコスト削減になります。

なお、DeepSeek社の公式APIを使う場合は有料ですが、トークン単価はOpenAI APIの約1/10と非常に安価です。ローカル実行が難しい環境ではAPI経由も選択肢になります。

メリット・デメリット

メリット

完全無料で推論特化AIを使えます。ChatGPT PlusやClaude Proに月額を払わなくても、推論タスクに特化した高品質なAIを手元で動かせます。

データが外部に送信されません。クライアントの機密情報・個人情報を含む文書の分析や、NDA案件の作業にも安心して使えます。フリーランスにとってこの点は大きなメリットです。

インターネット接続なしで動作します。オフラインの移動中・カフェのWi-Fiを使いたくない場面でもAIを利用できます。

オープンソースのため、カスタマイズや商用利用に制限がありません。自分の業務に合わせたファインチューニングも可能です。

デメリット

ローカル実行には一定のPCスペックが必要です。7Bモデルでも6GB以上のVRAM(またはApple Silicon Mac)が必要で、古いPCでは実用的な速度が出ません。

蒸留モデル(7B/14B)の品質はフルサイズモデルやChatGPT o3、Claude Opus 4には及びません。日常的な推論には十分ですが、最高品質の推論が必要な場面ではクラウドモデルとの併用が現実的です。

最新情報を取得できません。ローカルモデルは学習データのカットオフ以降の情報を持っていないため、最新のニュースや技術動向に関する質問には対応できません。

セットアップに技術的な知識が必要です。Ollamaを使えば比較的簡単ですが、それでもコマンドライン操作に抵抗がある人にはハードルがあります。

日本語対応

DeepSeek R1は日本語に対応していますが、英語と比較すると品質に差があります。

7Bモデルの場合、日本語での回答は文法的に正しいものの、表現が不自然になることがあります。14Bモデルでは日本語品質が改善され、実用的なレベルの日本語回答が得られます。

日本語プロンプトで日本語の回答が返りますが、推論過程(

日本語品質をさらに上げたい場合は、システムプロンプトで「日本語で回答してください。自然な日本語表現を使ってください。」と明示的に指示すると改善されます。

ChatGPT o3やClaude Opus 4と比較すると、日本語の自然さではまだ差がありますが、推論タスク(数学・コーディング・論理分析)では言語の影響が小さいため、実用上は大きな問題になりません。

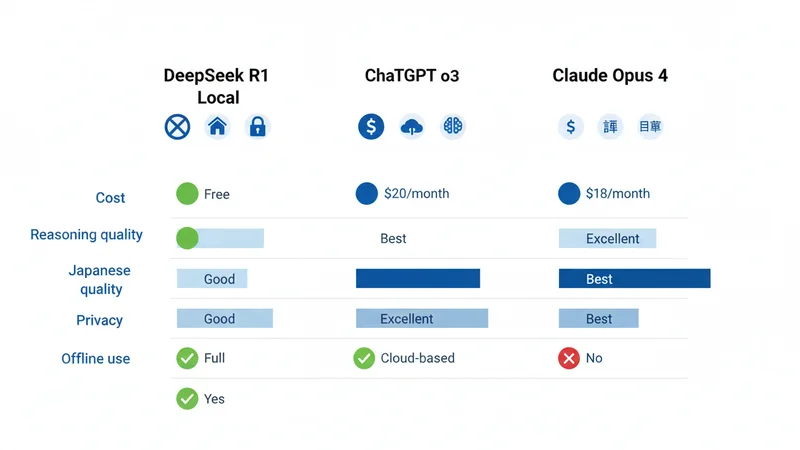

ChatGPT o3・Claude Opus 4との比較

| 比較項目 | DeepSeek R1(ローカル7B) | ChatGPT o3 | Claude Opus 4 |

|---|---|---|---|

| 月額コスト | 0円 | $20(Plus) | $18(Pro) |

| 推論の深さ | 良好 | 最高 | 非常に高い |

| 応答速度 | PC性能依存 | 遅い(数秒〜数十秒) | 標準 |

| 日本語品質 | 実用的 | 高い | 非常に高い |

| データプライバシー | 完全(ローカル) | クラウド送信 | クラウド送信 |

| オフライン利用 | 可能 | 不可 | 不可 |

| 最新情報対応 | 不可 | 対応 | 対応 |

| セットアップ難度 | やや高い | 簡単 | 簡単 |

DeepSeek R1のローカル実行は「無料・プライバシー・オフライン」で優位性があり、ChatGPT o3やClaude Opus 4は「推論品質・日本語品質・手軽さ」で優れています。

フリーランスの実務的な使い分けとしては、機密情報を含むタスクやコスト削減目的にはDeepSeek R1ローカル、最高品質の推論が必要な場面にはChatGPT o3、日本語品質と汎用性を重視する場面にはClaude Opus 4がおすすめです。

「普段はDeepSeek R1をローカルで使い、本当に重要な場面だけChatGPT PlusやClaude Proに切り替える」という運用が、フリーランスのコスト最適化に有効です。

よくある質問(FAQ)

GPUがなくてもDeepSeek R1は動きますか?

1.5Bモデルと7BモデルはCPUだけでも動作します。ただし応答速度が大幅に遅くなり、7Bモデルの場合は1回の応答に30秒〜数分かかることがあります。Apple Silicon Mac(M1以降)であればGPU統合メモリを活用できるため、専用GPUなしでも実用的な速度で動作します。

商用利用しても問題ありませんか?

MITライセンス(フルモデル)またはApache 2.0ライセンス(蒸留モデル)で公開されており、商用利用に制限はありません。クライアント案件への活用・自社サービスへの組み込みも可能です。

ChatGPTの代替として使えますか?

推論タスク(数学・コーディング・論理分析)では十分に代替可能です。ただし、日常的な会話・クリエイティブな文章生成・最新情報の質問応答ではChatGPTの方が優れています。用途によって使い分けるのが現実的です。

モデルのアップデートはどうしますか?

Ollamaで `ollama pull deepseek-r1:7b` を実行すれば最新版に更新されます。ただし、ローカルモデルのアップデート頻度はクラウドサービスほど高くありません。

セキュリティリスクはありますか?

ローカル実行自体はデータが外部に送信されないため安全です。ただし、DeepSeek社は中国企業であるため、DeepSeekの公式アプリやAPIを使う場合はデータの取り扱いポリシーを確認してください。ローカル実行であればこの懸念は該当しません。

フリーランスの活用事例

フリーランスエンジニアが、NDA付きのクライアントコードをDeepSeek R1ローカルで分析し、バグ修正やリファクタリングの提案に活用しています。コードがクラウドに送信されないため、NDA違反のリスクなしにAIの支援を受けられます。

フリーランスライターが、記事の論理構成チェックやファクトチェックの下調べにDeepSeek R1を使い、月額のAIツール費用をゼロに抑えています。最終的な品質チェックのみClaude Proを使う二段構えの運用です。

個人事業主が、確定申告に関する税務の論理的な質問(経費算入の可否判断など)をDeepSeek R1ローカルに相談しています。売上データや経費明細をクラウドに送らずにAIの見解を得られる点が評価されています。

データ分析を行うフリーランスが、クライアントの売上データをDeepSeek R1ローカルに分析させ、傾向把握やレポートのドラフト作成に活用しています。データ流出リスクがゼロのため、金融系クライアントの案件でも使えると好評です。

注意点

DeepSeek R1のローカル蒸留モデル(7B/14B)は、フルサイズモデルやChatGPT o3と比較して推論品質が劣ります。重要なビジネス判断や専門的な分析には、回答の正確性を人間が検証するか、クラウドモデルで再確認してください。

中国企業が開発したモデルであるため、政治的・地政学的なトピックに関する回答にバイアスがかかる可能性があります。機密性の高いトピックでの利用時は、回答内容を批判的に確認してください。ただし、ローカル実行であればデータ送信の懸念はありません。

ローカル実行中はPCのリソース(GPU/CPU/メモリ)を大量に消費します。他の業務と並行して使う場合は、PCのスペックに余裕があることを確認してください。特にGPU使用時は、動画編集ソフトなど他のGPU依存アプリとの同時使用で速度が低下します。

Ollamaのモデルダウンロードには数GB〜数十GBの通信量が発生します。モバイル回線やテザリングでのダウンロードは避け、固定回線を使ってください。

総評

DeepSeek R1のローカル実行は、フリーランスや個人事業主にとって「コストゼロでAI推論を使える」という明確なメリットを持つ選択肢です。Ollamaを使えばセットアップはコマンド2つで完了し、技術的なハードルも低めです。

推論品質はChatGPT o3やClaude Opus 4のフルモデルには及びませんが、7Bモデルでも日常的な推論タスク(コードレビュー・論理分析・数学的検証)には十分な品質を持っています。データプライバシーの観点では、ローカル実行に勝る選択肢はありません。

「毎月のAIサブスク費用を削減したい」「機密データをクラウドに送りたくない」「オフラインでもAIを使いたい」という課題を持つフリーランスには、試す価値のあるツールです。

まずはOllamaをインストールして `ollama run deepseek-r1:7b` を実行してみてください。セットアップの簡単さと推論品質に驚くはずです。

まとめ:無料で使える推論AIをローカルに

DeepSeek R1は、オープンソースの推論特化AIモデルをローカルPCで完全無料で動かせるツールです。

コスト削減とデータプライバシーの両方を実現したいフリーランスにとって、ChatGPT PlusやClaude Proと併用する「ハイブリッド運用」の片翼として有力な選択肢になります。

Ollamaをインストールして、まずは7Bモデルから試してみてください。ローカルAIの実力を体験できます。

コメント